Trápí mne ale úplně jiná věc. Přestože databáze je původní a pouze jsem na základě šablony Template.tabmenu.cz stvořil svou verzi http://kiregps.sweb....e.tabmenu.cz.my, statistika obsahuje 2253 nálezů místo správných 1942. Přitom původní template (http://kiregps.sweb..../Template.en.my) nad stejnými daty dává správný výsledek, i spuštěcí BAT je (až na jméno šablony) identický.

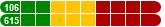

Zkoumal jsem GeoGet, který vytrvale ukazuje správné počty keší (těch 1952 ks je součet 1942 nalezených a 10 vlastních, zbylá vlastní je adoptovaná a tedy dříve zároveň nalezená):

Databáze tedy obsahuje duplicitní logy. Potvrzeno u starších keší, kde je to vidět i v náhledu listingu:

Nevím, jak se to stalo. Pravdou je, že jsem databázi aktualizoval různě, občas i pomocí GeoJarry. Divné je, že se starou šablonou se duplicity nepočítají a že nelze sjednat nápravu doporučeným postupem (Databázové nástroje - Oprava databáze - Odstranění zapomenutých záznamů).

Než začnu psát nějaké zoufalé skripty, prosím o radu a pomoc. Přece si nebudu nahánět body tímto způsobem.

Předem díky...!

P.S.

Když už jsem v těch dotazech. Poradí mi někdo, jak do tabulky FTF dostat pořadové číslo FTF (ne tedy standardně zobrazované pořadové číslo nalezené kešky)?

Toto téma je zamknuto

Toto téma je zamknuto

GeoGet

GeoGet

URWIGO

URWIGO

CWG

CWG

Ještěrka zdarma

Ještěrka zdarma

Významné stromy

Významné stromy

publish

publish